更多“回归问题的学习等价于函数拟合:选择一条函数曲线使其很好地拟合…”相关的问题

更多“回归问题的学习等价于函数拟合:选择一条函数曲线使其很好地拟合…”相关的问题

第1题

随机森林利用随机的方式将许多决策树组合成一个森林,每个决策树在分类的时候决定测试样本的最终类别。它的优点是()。

A.级别划分较多的属性不会影响模型效果

B.在某些噪音较大的分类或回归问题上不会过拟合

C.每次学习使用不同训练集,一定程度避免过拟合

D.能够处理高纬度的数据,并且不做特征选择

第3题

激活函数Sigmoid函数单调连续,输出有界,网络比较容易收敛,在一段时间内使用比较广泛,但是当网络比较深时,容易导致什么问题?()

A.梯度减少问题

B.XOR问题

C.梯度消失问题

D.过拟合问题

第4题

下面对逻辑斯蒂回归(logistic regression)和多项逻辑斯蒂回归模型(multi-nominal logistic model)描述不正确的是()。

A.两者都是监督学习的方法

B.多项逻辑斯蒂回归模型也被称为softmax函数

C.两者都可被用来完成多类分类任务

D.逻辑斯帝回归是监督学习,多项逻辑斯蒂回归模型是非监督学习

第5题

在建立多元线性回归模型时,需要对自变量进行筛选,最后确定适合的回归模型。下面的陈述中错误的是()

A.向前选择法是从模型中没有自变量开始,然后将所有自变量依次增加到模型中

B.向后剔除法是先对所有自变量拟合线性回归模型,然后依次将所有自变量剔除模型

C.逐步回归法是将向前选择法和向后剔除法结合起来,但不能保证得到的回归模型一定就显著

D.逐步回归法选择变量时,在前面步骤中增加的自变量在后面的步骤中有可能被剔除,而在前面步骤中剔除的自变量在后面的步骤中也可能重新进入到模型中

第7题

下面对梯度下降方法描述不正确的是()。

A.梯度方向是函数值下降最快方向

B.梯度下降算法是一种使得损失函数最小化的方法

C.梯度下降算法用来优化深度学习模型的参数

D.梯度反方向是函数值下降最快方向

第8题

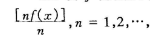

设f为定义在区间(a,b)内的任一函数,记fn(x)=证明函数列{fn}在(a,b)内一致收敛于f.

设f为定义在区间(a,b)内的任一函数,记fn(x)= 证明函数列{fn}在(a,b)内一致收敛于f.

证明函数列{fn}在(a,b)内一致收敛于f.

第9题

证明:若函数f(x)在R有任意阶导函数,且函数列{f(n)(x)}在R一致收敛于极限函数φ(x),则φ(x)=cex,其中c是常数.

证明:若函数f(x)在R有任意阶导函数,且函数列{f(n)(x)}在R一致收敛于极限函数φ(x),则φ(x)=cex,其中c是常数.

点击查看答案

第11题

证明若函数{fn(x)}在区间l一致收敛于fn(x)}而每个函数f(x)在区间I有界,则函数列{fn(x)}在区间I一致有界.

证明若函数{fn(x)}在区间l一致收敛于fn(x)}而每个函数f(x)在区间I有界,则函数列{fn(x)}在区间I一致有界.

点击查看答案

如果结果不匹配,请

如果结果不匹配,请